(ZENIT Noticias / Roma, 16.08.2023).- El Dicasterio para la Cultura y Educación del Vaticano se ha vinculado al Centro Markkula de Ética Aplicada de la Universidad de Santa Clara y el resultado ha sido un libro con pautas para el uso de la Inteligencia Artificial (IA). Se trata de una obra que algunos medios han querido calificar como el “manual del Vaticano para la IA”.

El libro se llama ‘Ethics in the Age of Disruptive Technologies: An Operational Roadmap’ (algo así como ‘Ética en la era de las tecnologías disruptivas: una hoja de ruta operativa’) y de hecho la obra está online. Se ha ocupado de publicarla el Instituto de Tecnología, Ética y Cultura (ITEC), realidad surgida de la asociación entre el Vaticano y el centro de la Universidad de Santa Clara.

“Este libro pretende brindar orientación para los esfuerzos de ética pero no pretende funcionar como asesoramiento legal o asesoramiento de gestión”, dicen los autores, los cuales también refieren que “como centro de ética estamos entregando un documento donde brindamos los conceptos y marcos éticos, mientras que las organizaciones aplican su propia gestión y legal

Juicio”.

Una parte de la introducción está firmada por un obispo que trabaja en la Santa Sede (aunque por alguna razón ni su puesto en el Dicasterio para la Cultura y Educación ni su identidad episcopal está evidenciada): Paul Tighe. Su aportación comienza con “Unas palabras desde Roma”:

Me complace enormemente acoger con satisfacción el lanzamiento del Manual ITEC, fruto de una cooperación un tanto improbable entre el Centro Markkula de Ética Aplicada, profesionales experimentados de los sectores de la tecnología y la gestión, y el Centro de Cultura Digital del Dicasterio para la Cultura y la Educación del Vaticano. Agradezco especialmente a los autores principales la generosidad y competencia de su contribución. El proceso que han dirigido, y que ha culminado en esta publicación, ha sido un ejercicio de integración de diversas formas de experiencia, de escucha y aprendizaje mutuo. Desde que empecé a reunirme y hablar con altos representantes de Silicon Valley, especialmente con los que trabajan en el ámbito de la inteligencia artificial y el aprendizaje automático, me ha impresionado su deseo de mantener altos niveles éticos para sí mismos y para su industria. Esto ya queda claro en el número de iniciativas que tratan de garantizar que la tecnología esté al «servicio de la humanidad», «para el bien», «centrada en el ser humano», «ética por diseño» y «abierta».

Este deseo de mantener normas éticas refleja tanto un compromiso intrínseco de hacer el bien como una aversión realista al riesgo de daños a la reputación y perjuicios comerciales a largo plazo. Lo que es realmente notable es el grado de consenso que ha surgido en cuanto a la definición de los valores éticos que deben guiar la investigación y el desarrollo en tecnología: valores como la inclusión, la transparencia, la seguridad, la equidad, la privacidad y la fiabilidad se identifican sistemáticamente como fundamentales para la correcta búsqueda de la innovación en tecnología y figuran en las propuestas de valor de organizaciones y empresas de muy distintos tipos.

También resulta muy tranquilizador constatar el alto compromiso ético de los profesionales del sector, que en ocasiones se ha manifestado en su negativa por motivos de conciencia a trabajar en proyectos que consideran perjudiciales para el bienestar humano. Este manual es fruto del deseo de ayudar a directivos muy motivados y bienintencionados a integrar estos principios compartidos en la cultura de sus empresas y del sector en general.

Al hacerlo, reconoce la legítima pluralidad de sistemas de creencias y valores de quienes trabajan en el sector tecnológico y apela a los ideales y valores humanos básicos que pueden contar, y han contado, con una aceptación general. Pretende identificar procesos y mecanismos que garanticen un enfoque coherente e intencionado de la ética en la toma de decisiones y las prácticas operativas de las empresas. Se concibe como un trabajo en curso que se actualizará y ampliará a la luz de los comentarios de quienes decidan aplicarlo en su organización. Puede sorprender a algunos descubrir el compromiso del Vaticano con este proyecto, pero en última instancia es el resultado de reuniones – «encuentros», por utilizar una de las palabras favoritas del Papa Francisco- entre el Vaticano y el mundo de la tecnología. El manual es el resultado concreto del deseo de promover una conversación inclusiva entre el sector tecnológico y la comunidad humana en general, cuyo futuro estará determinado de muchas maneras por las decisiones que tomen quienes gestionan la innovación. Se trata de una conversación que debe incluir a personas de diversas nacionalidades, de diversas culturas y de diferentes credos y de ninguno, para que aprendamos juntos a construir un mundo mejor para todos.

Por su parte, los autores del Manual (José Roger Flahaux, Brian Patrick Green y Ann Gregg Skeet) recuerdan en el Prefacio que “Los líderes quieren lo mejor para su organización”. Pero también recuerdan que “El liderazgo requiere conocimientos, una visión clara, buen juicio, los recursos adecuados y no dejar nada al azar. Y dentro de esas categorías hay otra, la base no sólo de la buena práctica empresarial, sino de toda la sociedad humana: la ética. La ética es la base sobre la que la gente construye todo lo demás. Las buenas relaciones éticas generan confianza, y la confianza es el fundamento de toda institución social. Sin ella, las relaciones se desmoronan, y si se desmoronan suficientes relaciones sociales, ya no se vive en una sociedad, sino en la anarquía”.

Los autores señalan que “Aunque este libro no pretende abordar cuestiones sociales a tan gran escala, sí aborda directamente una de las palancas de poder más importantes de la sociedad: las empresas y otras organizaciones que desarrollan o trabajan con tecnologías avanzadas. Si algunas empresas y sus tecnologías perjudican a la sociedad, ésta se degradará, y si un número suficiente de empresas y sus tecnologías ayudan a la sociedad, ésta mejorará”. Por eso recuerdan que “Los líderes empresariales no son sólo líderes empresariales, sino también líderes destacados en la sociedad. Dependiendo de cómo actúen, se les admira o se les denigra. Sus acciones están fundamentalmente ligadas a la ética y marcan la pauta para su segmento de la sociedad. Y, sin embargo, si las decisiones de los líderes empresariales son tan vitales para el bienestar de la sociedad, ¿por qué habría alguno de tomar decisiones desalineadas con este objetivo? Hay muchas razones, pero una de ellas es la simple falta de concienciación y conocimiento sobre cómo establecer el tono ético adecuado en toda la organización y hacer operativo el pensamiento ético en todos los procesos de forma que las malas decisiones sean menos comunes y, con suerte, bastante raras”.

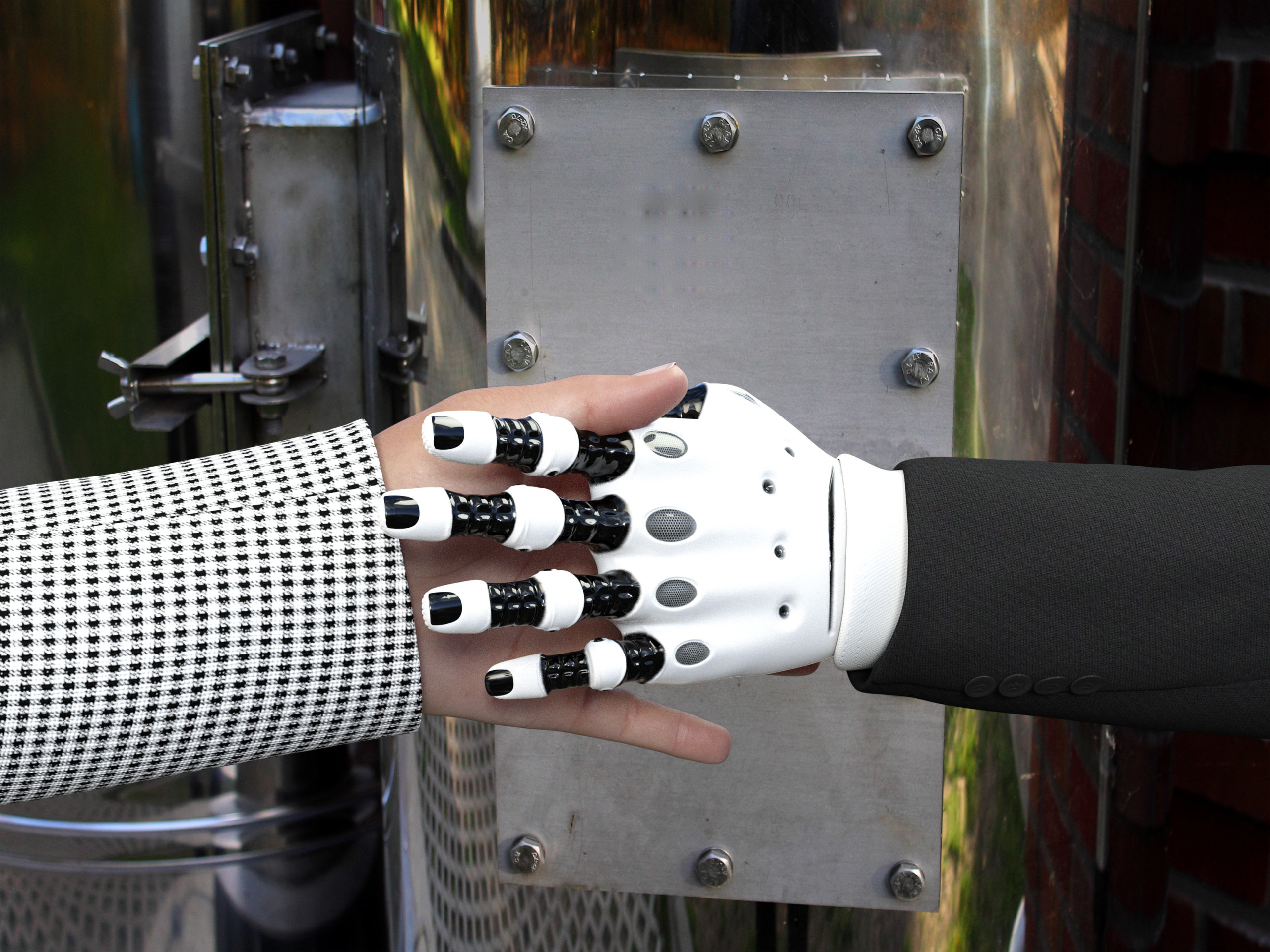

Tecnología – ©Pixabay

Finalmente, Flahaux, Green y Skeet ponen delante el propósito del Manual: “capacitar a los líderes empresariales y ayudarles a realizar un cambio positivo en sus empresas, con el plan, las herramientas y los recursos que necesitan para poner en práctica estos cambios para el bien común. Lo presentamos buscando continuar un diálogo e invitamos a responder. La ética nunca es una obra acabada, por lo que este manual también evolucionará con el tiempo. Esperamos sus opiniones”.

El sumario del libro lleva un título: “El camino del discernimiento al compromiso con la gobernanza y la acción tecnológicas”. Y en español dice lo siguiente:

“El contexto Tecnologías avanzadas como la inteligencia artificial (IA), el aprendizaje automático, los sistemas autónomos e inteligentes, la encriptación, el rastreo y el reconocimiento facial están cada vez más en el centro de los debates políticos y sociales. El público, los académicos, la sociedad civil, los gobiernos y los responsables políticos son cada vez más conscientes y están más preocupados por las tecnologías de procesamiento de datos y los algoritmos que las empresas están desarrollando en un entorno regulado de forma relativamente ligera e inconsistente. Algunas técnicas de vigilancia digital (reconocimiento facial y de voz, por ejemplo) se están creando y desplegando rápidamente con escasa supervisión externa, lo que genera importantes riesgos para la sociedad. En todo el mundo, legisladores y reguladores se apresuran a llenar este vacío. Si los líderes del sector no adoptan rápidamente un marco jurídico y ético fiable y de eficacia demostrable, se encontrarán rápidamente atrapados en un atolladero de leyes y reglamentos incoherentes e incluso contradictorios. Al mismo tiempo, no falta interés en el sector privado por garantizar que las tecnologías sean «éticas por diseño».

Esto está motivado no sólo por una preocupación intrínseca de actuar éticamente, sino también por el deseo de evitar daños a la reputación, crear culturas corporativas que atraigan a los mejores talentos y retener el compromiso de los empleados éticamente alerta.

Como parte de este proceso, muchas de las principales empresas que trabajan en estas novedosas tecnologías están asumiendo papeles de liderazgo para tratar de configurar el marco regulador de manera que no limite la innovación y proporcione ventajas a las empresas que operan en jurisdicciones no reguladas. Muchas empresas ya han identificado sus principios éticos y valores rectores y han intentado elaborar códigos deontológicos. Sin embargo, a menudo se quedan cortas cuando intentan hacer operativos esos principios y valores a nivel empresarial. Desean desarrollar y adoptar soluciones que satisfagan las necesidades de los clientes y contribuyan al bien común de la sociedad, evitando al mismo tiempo los perjuicios sociales, pero no saben exactamente cómo hacerlo. En un entorno empresarial exigente en el que el éxito depende a menudo de la rapidez de comercialización y adopción por parte de los usuarios, las organizaciones se esfuerzan por evitar las repercusiones negativas de las tecnologías que crean, como la discriminación, la desinformación, las amenazas a la seguridad humana y las amenazas a la privacidad. Sólo adoptando un marco con prácticas y procedimientos coherentes y auditables puede la industria aplicar eficazmente normas éticas que funcionen a lo largo de todo el ciclo de vida de un sistema.

El reto al que se enfrentan las empresas a la hora de dar primacía a las cuestiones éticas se ve agravado por las obligaciones legales y de gobernanza de los directivos cuando se enfrentan a estas mismas cuestiones éticas. Durante el último medio siglo se ha instruido a los directores de que el fin del gobierno corporativo debe ser maximizar el valor a largo plazo para el accionista, siempre y cuando las medidas que se tomen sean legales y satisfagan el sentido básico de la ética del consejo.

Lo que es mejor para otras partes interesadas de la empresa, como las comunidades, el funcionamiento de la sociedad, los empleados y los consumidores, debe verse a través de una lente que se correlacione con la mejora del valor para el accionista. Esta teoría, conocida como «primacía del accionista», centrada en aumentar la rentabilidad o el valor a largo plazo para el accionista, se ha justificado como necesaria para evitar que los directivos apoyen causas sociales o políticas que no estén directamente relacionadas con los beneficios empresariales. De acuerdo con el modelo de primacía del accionista, otras partes interesadas, ya sean empleados, consumidores o la sociedad, están protegidas por otros cuerpos legales. Aunque en los últimos años ha habido algunos desafíos al modelo de primacía del accionista, y se están desarrollando nuevas estructuras y modelos corporativos para dar a los consejos mayor discreción para considerar otros asuntos, el sistema legal que rige la mayoría de las corporaciones sigue basándose en el modelo de primacía del accionista. Del mismo modo, aunque algunos inversores institucionales han instado a los consejos de administración a prestar más atención a las cuestiones medioambientales, sociales y de gestión, los consejos de administración y los directivos siguen siendo juzgados principalmente por la rentabilidad de la empresa.

Como resultado, un reto crítico al que se enfrentan los líderes empresariales en el nuevo mundo de la IA y las tecnologías avanzadas es cómo gestionar la empresa dentro del modelo de primacía del accionista y, al mismo tiempo, alcanzar los conceptos más amplios de comportamiento ético tal y como lo ven las partes interesadas internas y externas. Un factor que potencialmente complica aún más esta cuestión es que el derecho de sociedades otorga hoy a las empresas una capacidad sustancial para influir en el desarrollo de las políticas legales, reglamentarias y sociales que rigen el uso de estas nuevas y potentes tecnologías. Por consiguiente, sólo demostrando con éxito la eficacia de los valores éticos adoptados y aplicados puede un consejo de administración establecer realmente un marco que permita a la empresa cumplir sus obligaciones para con las partes interesadas, incluida la consideración de las cuestiones éticas, sociales y políticas creadas por estas tecnologías revolucionarias. Todas estas consideraciones han conducido al enfoque de mosaico de la industria para el desarrollo ético de productos y servicios. Lo que sigue faltando es un marco lógico, práctico, escalable y repetible en el que las empresas puedan confiar no sólo para alcanzar sus objetivos, sino también para demostrar su eficacia a través de métricas y procesos auditables.

Esa necesidad es la que cubre el Manual ITEC.

A finales de julio de 2023 el gobierno de los Estados Unidos fue el primer en llegar a unos primeros acuerdos orientados a regular el desarrollo y uso de la IA. En los acuerdos con Microsoft, Alphabet, Meta Platforms, Amazon, Anthropic, Inflection y OpenAI, el gobierno USA logró consenso en tres puntos: revelar qué contenidos son generados con inteligencia artificial, transparencia de resultados y garantías de seguridad.

Este mes de agosto la Santa Sede notificó que el Papa hablará de Inteligencia Artificial en su Mensaje para la Jornada Mundial de la Paz de 2024. Papa Francisco ya hizo una alusión a la IA en un muy interesante discurso a los participantes en el encuentro de los «Minerva dialogues» promovido por el Dicasterio para la Cultura y la Educación de la Santa Sede el pasado 27 de marzo de 2023.